作为一名解决方案,知识面一定要广,在某个领域一定要深,成为所谓“T”字型人才。可是随着科技的进步,一个“T”有可能不够立足了,就得搞多个“T”,成为“TTTT”型人才。所以大模型知识,尤其是LLMs企业级应用相关知识,未来可能也必须成为一名金融领域解决方案的新“T”。

所以作为一名非大模型行业从业人员,我近期也是借着DeepSeep的东风,恶补了大模型和未来应用的一些行业知识,也及时进行了知识整理和归纳总结:

同时,我也了解了以DeepSeek为代表的大模型家族,并尝试了本地化部署和对外发布大模型服务,到目前为止都比较OK,但是大模型技术如何真正落地,如何服务于各行各业,就非常考验一个人或者一个公司的工程化经验和能力了。

本人虽是计算机科班出身,也有10年左右的代码经验,但毕竟我目前的工作是以解决方案为主,想快速的实现基于大模型的应用开发,还是需要一段时间的,不着急,可以慢慢来。

本文抛开大模型应用的工程coding,先来汇报一下我目前所学习了解的大模型应用开发的可行路径。

1.大模型应用方向

个人认为,目前大模型的主流应用方向包括三大类:

- 大模型微调

- RAG(搜索增强生成)

- Agent

1.1 大模型微调

大模型微调跟RAG(搜索增强生成)技术类似,都是为了解决大模型在垂直专业领域的幻觉问题,或者是因最新时间的知识没有学习到而导致的幻觉问题。

但大模型微调需要的算力要比RAG要大很多,因为他本质上还是用新的数据(要么是专业领域的知识数据,要么是最新的知识数据)去对预训练通用大模型进行再训练,最终生成的还是一个新的模型。而只要涉及到模型训练,都是非常吃算力的。

因此大模型微调不适用于个人应用,只适用于企业级应用。举个例子,一个银行部署了DeepSeek本地满血大模型,希望应用到自动化的客服系统,用于直接对客或者为客服提供话术支持。银行就可以把自己本地积累的金融专业知识、客户专业话术、客户礼貌用语等一并打包形成训练数据,并微调DeepSeek大模型,那么训练好的大模型就是有着该银行的风格、画风甚至于说话语气的客户智能聊天机器人。

1.2 RAG(搜索增强生成)

RAG与大模型微调相比,最大的区别就是,他不会生成一个新的模型。模型还是那个模型,只是给模型加了一个智囊团,使他变得更强大。就像刘备有了诸葛亮相助之后,才会脱掉“常败将军”的大帽子。

RAG的基本原理是:专业领域的知识或者新知识,作为数据向量化后存入向量数据库,作为大模型的知识库;大模型在接到任务后,会把输入上下文进行分词分块,并去向量数据库中进行相似查询,找到答案,与本身掌握的知识进行合并,并加以润湿生成最终的答案作为输出。

RAG因为不用重新训练模型,因此不需要大的算力支持,非常适合于个人开发者或者轻量级的企业应用。

1.3 Agent

Agent被很多行业专家指定为未来最主流的大模型应用方式。

Agent是可以解决现实生活复杂问题的综合体,你可以叫他代理、或者助手。我理解他的最终形态就是一个类人硅基生物,他可以有实体,也可以只是一个应用程序。

因为大模型本身的局限性,他的输入和输出是固定形态,中间又是一个黑盒子,这样的应用无法进行拓展,导致了他本身是无法处理复杂任务的,。换句话说,他只能解决文本或图像或视频生成问题。我们举个例子:DeepSeek非常强大,但是他只能生成文本,而不能同时生成图像和视频,目前没有哪个大模型可以做到,而且可以预想到实现一专多能的大模型难度非常大。再比如,DeepSeek可以生成PPT大纲,但是无法直接生成PPT,必须借助于PPT生成工具才可以完成这个复杂任务。

而Agent专门来解决这一复杂问题。在一个Agent中,大模型只是作为其中思考、决策、生成的一个工具,但不是全部。除了大模型之外,还需要很多其他的工具、插件按照一定的工作流程进行编排组成一个agent。

作为一个解决方案专家,如果你拥有一个Agent,他可以自动的对招标文件进行拆解,并按照招标要求进行标书的编写,最终形成一个投标文件word,并生成PDF,是多么幸福的一件事情。

但其实细想一下,整个过程要实现完全自动化,是非常复杂的。包括了招标文件的拆解,废标项的识别,格式文件的识别,按格式要求生成投标文件大纲,资质文件的补充,技术方案的编写,案例的挑选和编写,最终的文档合成等等。这里面大模型可以做的事情解决的问题非常有限。换句话说,有了大模型之后,这个任务的复杂度没有降低太多。

当然自动写标书是非常复杂的一个场景,我们可以先从简单的场景来入手,一步一步构建复杂智能体。简单的场景就包括构建一个专属电商客服聊天机器人,除了日常问答、聊天,还可以调用接口解决一些商品售后问题,比如帮助客户退换货等等。

或者一个旅行小助手,专门帮您生成旅行攻略,满足你的一切需求,根据你的口味生成当地美食攻略,根据行程安排和天气情况形成每日日程,根据当地风俗和节假日生成特定节日庆典日程等等。

2.大模型应用框架

应用开发要永远记住两句话:不需要重复造轮子,你造的轮子未必就比别人好。要站在巨人的肩膀上。

Python就有非常好的一个环境,你可以站在巨人的肩膀上,专心你的核心功能,而不需要太关心底层。当然要想做到极致,有的时候底层的性能也有优化的空间。

在大模型预训练阶段,比较常用的框架如Transformer、PyTorch等等,而大模型应用领域,也有一些成熟的开源框架。

2.1 Dify-大模型应用(RAG、agent)定制可视化工具

Dify官网:https://dify.ai/zh。

官方网站slogen:生成式 AI 应用创新引擎—开源的 LLM 应用开发平台。提供从 Agent 构建到 AI workflow 编排、RAG 检索、模型管理等能力,轻松构建和运营生成式 AI 原生应用。比 LangChain 更易用。

可视化的应用开发,托拉拽方式,更适用于没有编程基础的业务专家或流程专家使用。

试用了一段时间,缺点也是显而易见的,那就是不够灵活,拓展性不强,并且很多插件和工具都没有。如果要真正实现复杂任务(比如写标书)的自动化工具,难度很大。

2.2 AutoGen-大模型应用(RAG、agent)定制可视化工具

https://microsoft.github.io/autogen/stable

AutoGen是微软公司亲自下场构建的AI智能体和应用的构建平台。也是可视化的。可以应用于RAG和agent的开发,以及工作流的编排和开发。

官网使用github,整体页面风格还是比较低调的。

2.3 Llamaindex-大模型应用(RAG、agent)定制无可视化工具

Llamaindex,是一款无可视化的大模型应用开发工具。可扩展性强,基于python代码进行应用开发。

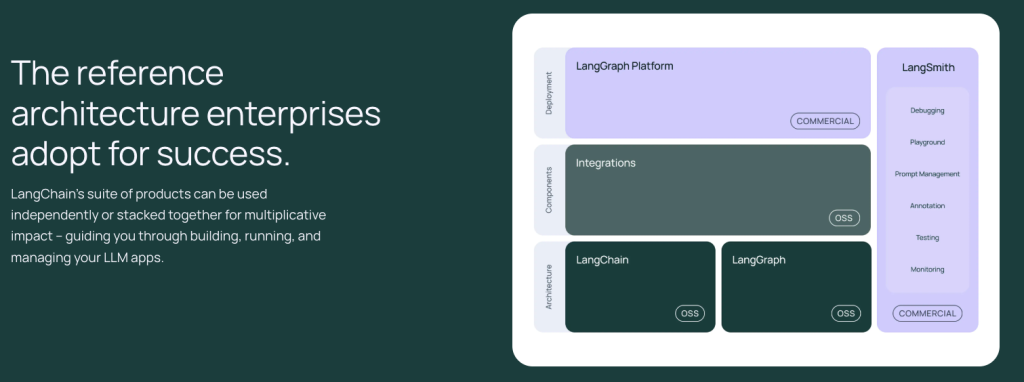

2.4 LangChain-大模型应用(RAG、agent)定制无可视化工具

LangChain也是目前应用比较广泛的大模型应用开发框架,其本身是无可视化平台的。但是其推出了LangGraph专门用于AI应用开发的可视化。同时也推出了LangSmith用于大模型应用的全生命周期管理。可以说LangChain生态的架构还是比较完善的。

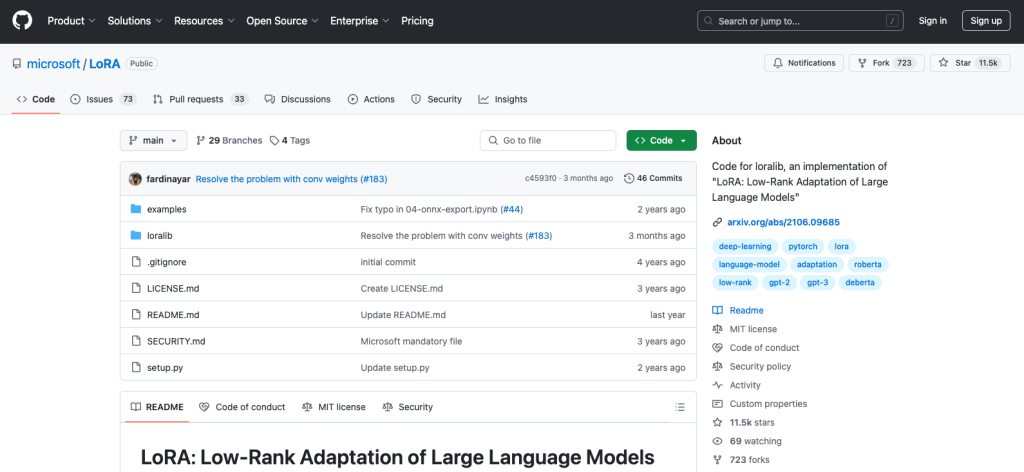

2.5 Lora微调

https://github.com/microsoft/LoRA

LoRA: Low-Rank Adaptation of Large Language Models

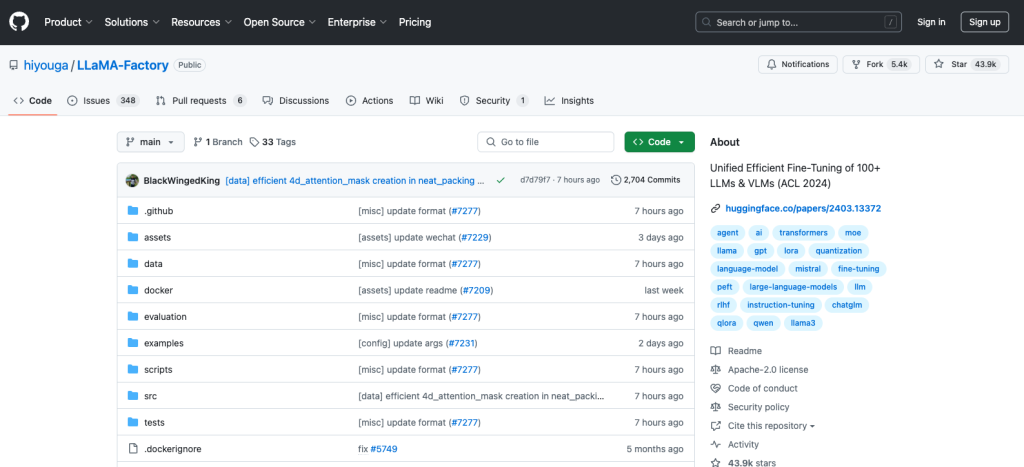

2.6 LlaMA-Factory微调可视化工具

https://github.com/hiyouga/LLaMA-Factory

使用零代码命令行与 Web UI 轻松微调百余种大模型。

发表回复