DeepSeek大模型部署安装之阿里云ECS2C2G服务器

用现在时髦的话说,元音AI(UOEAI.COM)已经全面接入满血版DeepSeek!!!

2025年2月27日,DeepSeek重新开启充值通道,本人异常兴奋,为了迅速扫除没有及时使用之前注册赠送10元导致过期带来了不悦,本人怒充10元尝鲜,截止目前,还剩9.92,哈哈。消费非常合理,计价也很透明,目前测试,也不会遇到服务器繁忙问题,优先级比网页和app免费版要高。

话不多说,直接切入正题。

本文介绍如何在云服务器上部署安装常用大模型,并且对外发布大模型服务。涉及使用Ollama进行大模型的本地部署和安装、构建miniconda开发环境、并在miniconda中进行Open webUI部署和大模型服务配置。

核心内容如下,您可直接跳到感兴趣内容:

- 服务器配置

- Ollama安装

- 大模型本地安装部署

- miniconda安装配置

- Open webUI安装配置

完成这5步,就可以对外发布大模型服务了。我们就开始吧。

步骤1:服务器配置

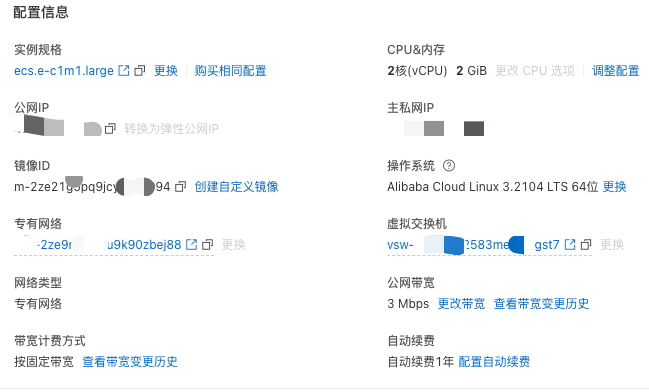

阿里云ECS服务器,虚拟机,2C2G,3M带宽,40G硬盘。已经跑了一个APACHE+Mysql+wordpress的网站。

步骤2:Ollama安装

Ollama是一款可实现在本地部署大模型的工具,支持目前主流的开源大模型,如deepseek、Qwen、Llama3等。在MAC、Windows、Linux操作系统上均可安装。

本地部署大模型的工具还有很多,比如LM studio等,我推荐Ollama。

Ollama官网如下:

Linux 下可以使用一键安装脚本,我们打开终端,运行以下命令:

curl -fsSL https://ollama.com/install.sh | bash安装完成后,通过以下命令验证:

ollama --version如果显示版本号,则说明安装成功。

步骤3:大模型本地部署安装

目前Ollama支持市面主流开源大模型,如国产之光DeepSeek、Qwen、llama3等,并且可以根据自己机器配置选择不同参数和量化版本安装。

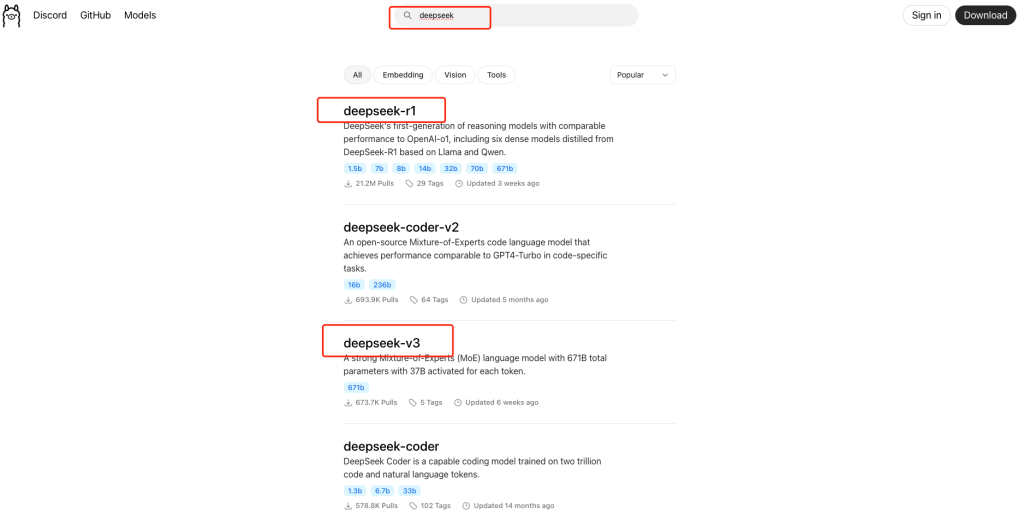

- 首先进入Ollama官网(https://ollama.com/),在搜索栏中输入想要本地部署大模型。以DeepSeek为例:

- 可以看到官方训练模型deepseek-r1和deepseek-v3,其他模型都是基于这两个模型的微调模型。我们选择具有推理能力的r1模型。

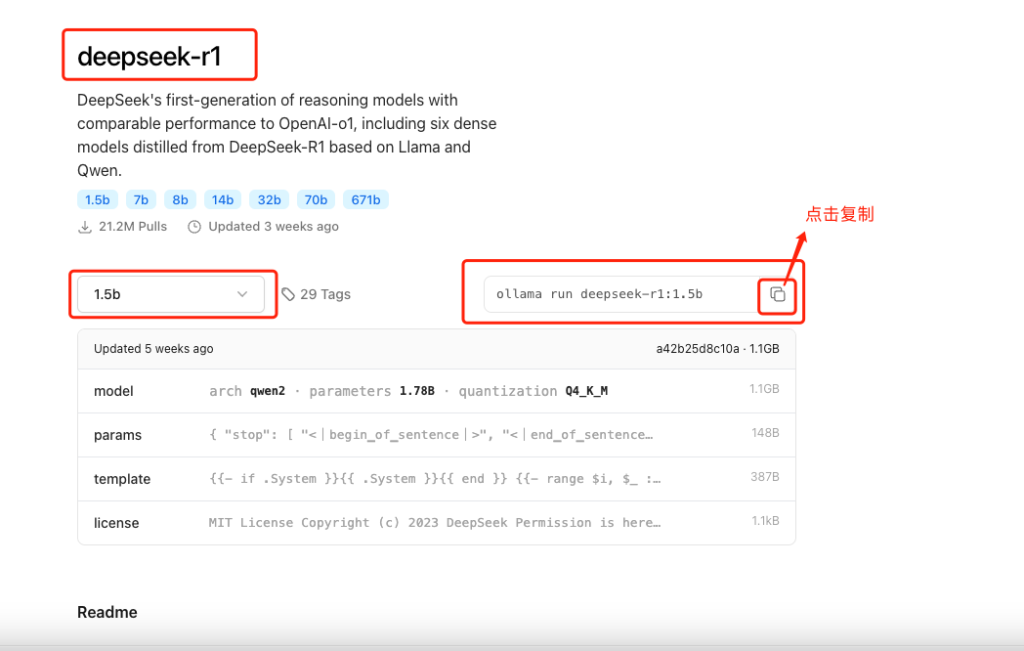

- 点进R1模型,有多个不同参数量的模型可供下载。根据机器配置,尤其是内存显存不同,选择不同版本进行下载,可点击复制命令行,直接在终端内运行命令,这里选择最低配1.5b模型下载。

ollama run deepseek-r1:1.5b

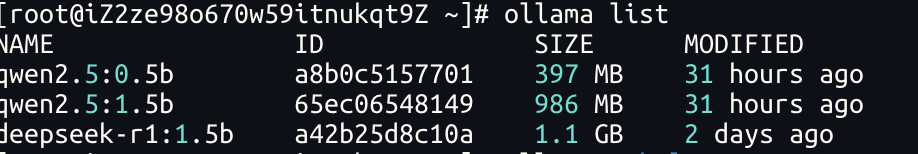

**下载完成后即可安装成功- 下载完成后直接本地运行模型。2C2G内存跑1.5b的deepseek- R1非常卡顿,根据多次尝试,主要跟内存有关。2G内存预计只能跑1b以下的大模型。当然如果有显存的话,大模型会优先使用显存,但是基本上遵循这个规律:2G显存跑1b,4G显存跑2b。因此按照同样的步骤,我同时下了qwen2.5的1.5b版和0.5b版。 同样1.5b版qwen也很吃力,0.5b版本token输出速率还可以。

总结:大模型在运行时需要在内存/显存中加载大模型文件和各类参数,因此非常吃内存。粗略估算满血版671b的deepseek需要1.2T以上内存,本地部署难度太大。网上所谓量化版的模型,是对模型的计算精度进行了降低,比如让原来F16精度(16位浮点运算)降低为F8(8位浮点运算),那么消耗的资源也会缩减一半,只是效果也会有所降低。

(PS:有网友提出的内存不够、SWAP来凑的临时解决方案,我也有尝试:在模型下载和加载时有一定帮助,但是运行模型推理时帮助甚微。)

那么,接入满血版Deep Seek只能选择接入官方API来实现,类似于花钱买deepseek公司的算力了。

接入DeepSeek 的API,并对外发布服务,需要一个WEB UI,我选择Open WebUI开源项目(https://github.com/open-webui/open-webui)。

步骤4:miniconda安装配置

安装Open WebUI有两种方式,一是使用docker部署,二是使用python部署,鉴于我的机器内存太小,docker部署要占用大内存,因此我选用python部署。

之前搞过数据分析和机器学习的小伙伴都知道,要想快速搭建python环境,最方便的就是使用conda,让你从繁杂的包依赖关系中解脱出来,可以快速实现环境搭建,并且根据不同项目需要,可以进行python环境隔离,避免不同环境相关影响。

anaconda 和miniconda之间,我选择miniconda,核心原因还是资源不够,40G硬盘也得省着点用不是。安装步骤如下:

- 下载安装脚本: 访问 Miniconda 官方网站,下载适用于 Linux 的安装脚本。通常的下载命令如下:

wget https://repo.anaconda.com/miniconda/Miniconda3-latest-Linux-x86_64.sh- 校验安装文件: 为了确保安装文件的完整性,可以使用

sha256sum或gpg校验文件。以下是校验文件完整性的方法:

# 校验文件哈希值

sha256sum Miniconda3-latest-Linux-x86_64.sh

# 校验文件签名

gpg --verify Miniconda3-latest-Linux-x86_64.sh- 运行安装脚本: 赋予安装脚本可执行权限,然后运行安装脚本:

chmod +x Miniconda3-latest-Linux-x86_64.sh ./Miniconda3-latest-Linux-x86_64.sh- 安装过程中设置参数: 在安装过程中,系统会提示你设置安装路径和是否将 Python 添加到系统环境变量。建议使用默认设置,但可以根据需要自定义安装路径。

- 安装完成: 安装完成后,执行以下命令将重新加载环境变量:

source ~/.bashrc- 验证安装: 通过以下命令验证 Miniconda 是否安装成功:

conda --version conda list- 如果安装成功,

conda --version将显示当前安装的 Miniconda 版本,而conda list将列出所有已安装的包。

如果无法显示或者报错,则需要手动将miniconda的路径加载到环境变量中:步骤如下:

- 确保 Miniconda 的安装路径已正确添加到系统的环境变量中。可以通过以下命令检查:

echo $PATH

- 如果 Miniconda 的路径(如

/安装路径/miniconda3/bin)不在PATH中,需要将其手动添加。执行如下命令:

export PATH="/安装路径/miniconda3/bin:$PATH"- 重新加载配置文件:

source ~/.bashrc- 验证miniconda是否安装成功。

- 如果环境变量已正确设置,但

conda命令仍然无法使用,可能是需要初始化 Conda。运行以下命令:

source ~/miniconda3/etc/profile.d/conda.sh

conda activate尝试输出conda版本,如果还是不行,可能需要重新安装了。

步骤5:Open webUI安装配置

miniconda安装完成后,Open webUI的安装比较简单:

- 在conda中为Open WebUI创建单独python环境,并指定python版本

conda create -n open-webui python=3.11.0

activate open-webui- 安装并启动Open WebUI

pip install open-webui

#启动

open-webui serve- 启动后,通过浏览器访问WebUI界面,http://ip地址:8080。并进行相应的大模型配置。

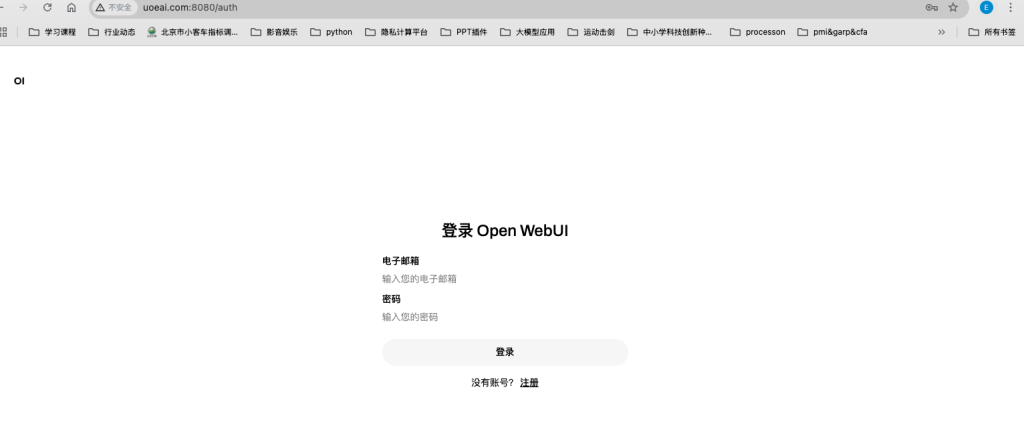

- 首先需要注册,才能登陆,第一个注册并登陆的用户,默认为管理员。

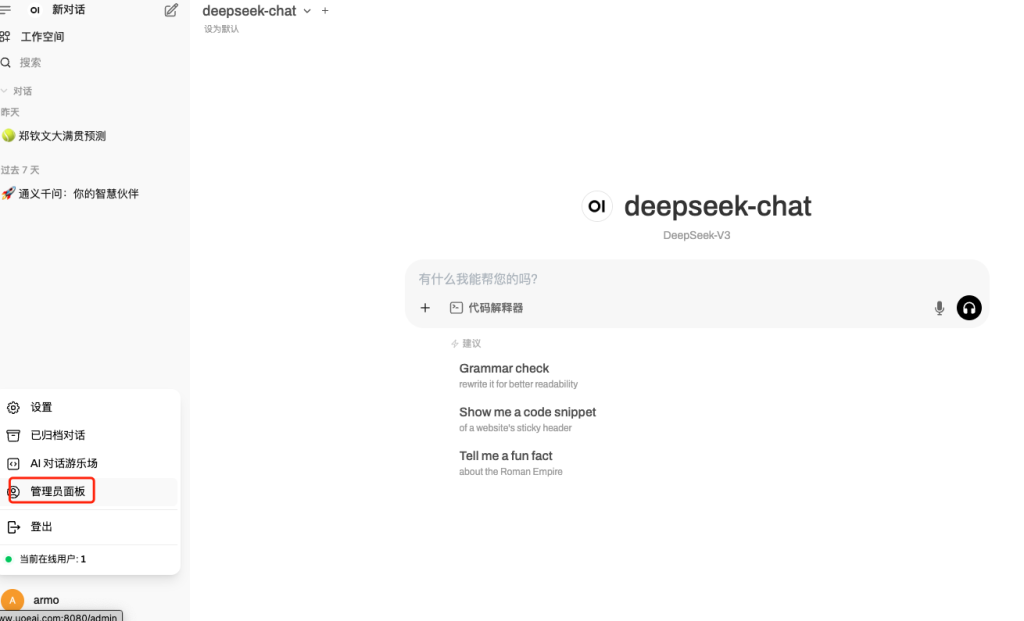

- 登陆后,需要配置大模型,可以进行API接入配置,或者通过Ollama来调用模型。

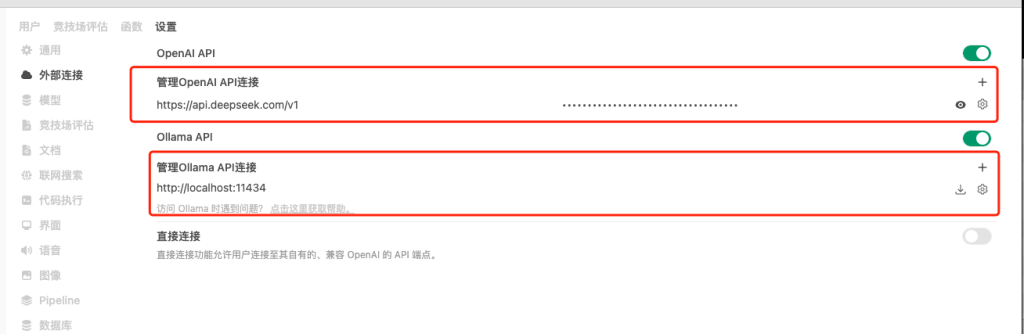

- 进入管理员面板后,点击外部链接,增加deepseepAPI接口,即https://api.deepseek.com/v1,并且添加合法API key。同时增加Ollama API连接。

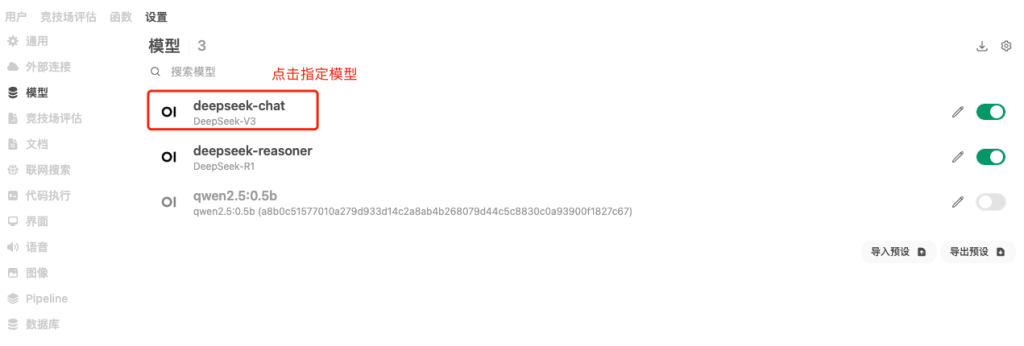

- 需要对单个模型进行配置:进入模型面板,点击指定模型,进入模型配置页面。

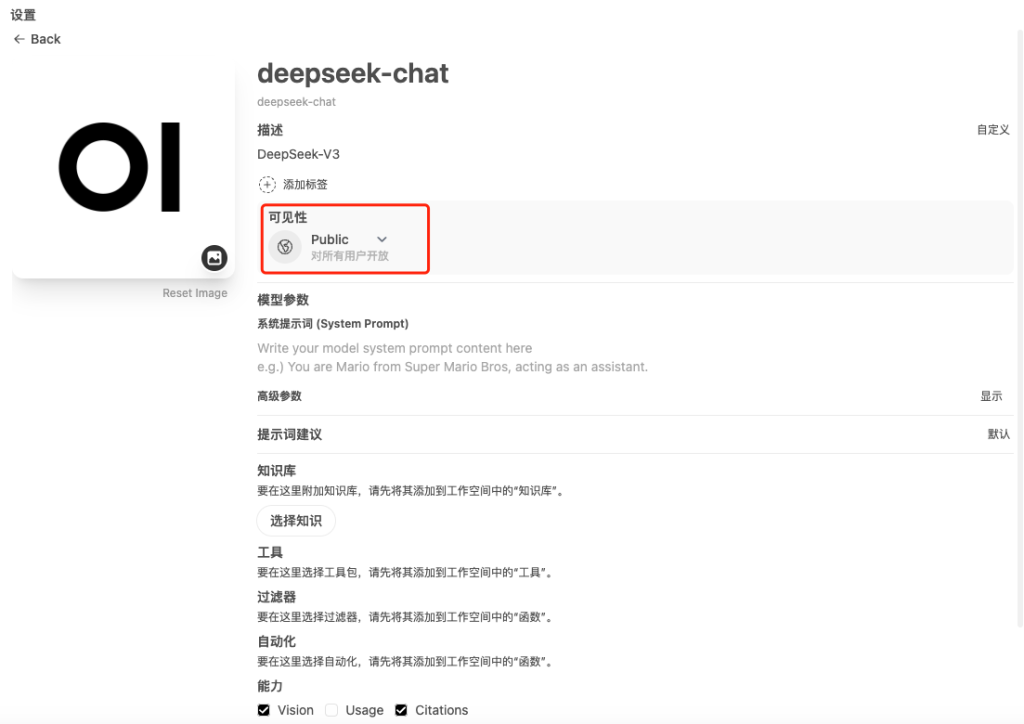

- 将模型可见性修改为public(这个很重要,不修改,非管理员的用户无法查看到可用模型),其他参数可根据需要进行修改。

- 在通用设置中,默认用户角色修改为待激活,允许新用户注册打开。

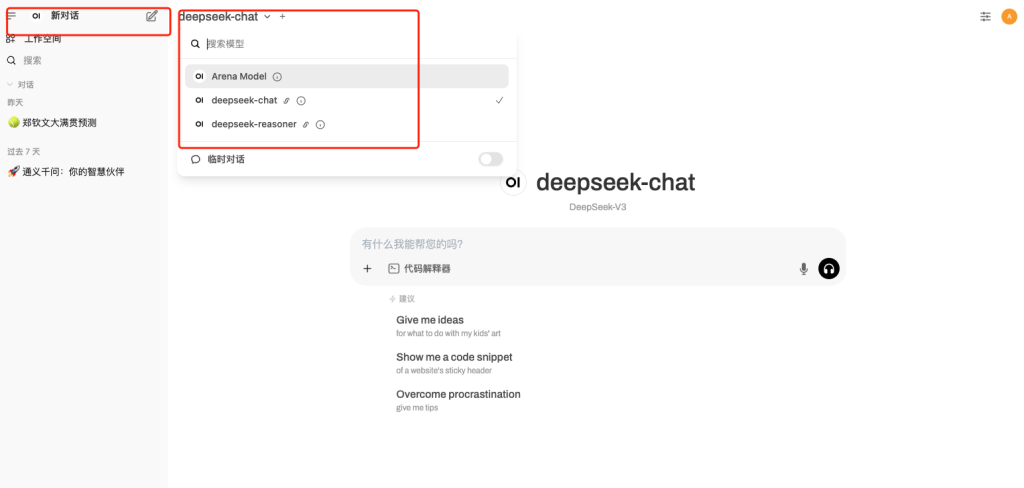

至此,大功告成。大模型服务对外发布成功,允许新用户注册,并获得管理员同意后,开启大模型探索之旅,通过创建新对话,并选择不同的大模型,进行智能查询、文档写作、文学创作等工作。bingo!!

发表回复